Já comentamos aqui no blog da 42 Filmes sobre algumas mudanças inevitáveis que a Inteligência Artificial deve promover no audiovisual. As questões éticas foram citadas, também, mas torna-se necessário comentar um pouco mais a respeito delas.

Recentemente, por exemplo, foi anunciada uma ferramenta do Adobe Premiere Pro que permitirá a edição de vídeos por meio de comandos de texto, ou seja, capaz de retirar a exigência de conhecimentos técnicos do uso do software. Isso pode aumentar a acessibilidade do programa, mas também reduzir as exigências técnicas para o trabalho de edição. A funcionalidade “Scene Edit Detection” é um outro exemplo que já permite a seleção de cortes previamente calculados a partir de uma análise das imagens gravadas.

No entanto, para além de ferramentas que podem facilitar funções já realizadas, e que parecem não substituir o trabalho artístico que envolve as escolhas finais de um processo, existem diversas questões éticas que precisam ser discutidas.

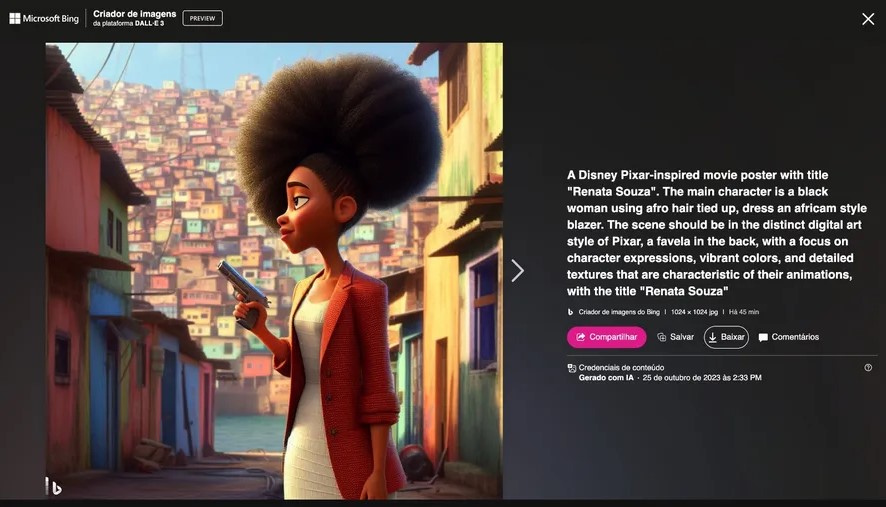

Perpetuação de preconceitos

Assim como os seres humanos que os fazem, os algoritmos podem ser preconceituosos e discriminatórios. Recentemente, uma deputada pediu para uma IA montar uma imagem com uma mulher negra em uma favela, e a ferramenta criou a imagem de uma mulher segurando uma arma.

Este e outros episódios destacam a importância de se ter equipes e grupos (tanto nas empresas quanto nas organizações da sociedade) focados em treinar modelos de IA, além das lutas constantes que serão necessárias contra possíveis vieses criados por uma inteligência artificial, o que reitera a necessidade da presença humana nos passos a serem dados pelos algoritmos.

Transparência

A falta de transparência pode ser uma das principais questões éticas a serem combatidas por ferramentas de inteligência artificial.

Conforme explicam os pesquisadores Dierle José Coelho Nunes e Otávio Morato de Andrade na Revista Eletrônica do Curso de Direito, as plataformas de inteligência artificial devem oferecer transparência em relação aos processos internos que levam os sistemas de IA a tomarem as suas decisões.

Existe a necessidade de regras que justifiquem as decisões tomadas pelos modelos de IA, evitando assim que haja o que é chamado de opacidade no modelo, ou seja, o oposto da transparência. É preciso que especialistas possam visualizar com clareza os motivos e cálculos que levam a IA a tomar as decisões que toma.

Informação falsa e roubo de arte

Pesquisadores da Universidade de Oxford já identificaram que uma IA pode espalhar informações falsas, já que se baseiam em dados presentes na rede. O mesmo pode ocorrer com a geração de imagens, que precisa de cuidados para evitar que obras de arte sejam utilizadas sem a devida autorização do autor ou pagamento de direitos autorais.

Estas preocupações envolvem possíveis danos que a IA pode causar à dignidade humana. A valorização do bem estar das pessoas deve ocorrer em todas as etapas de desenvolvimento de uma ferramenta, o que pede por regulamentação por parte dos órgãos governamentais.

No Brasil, podemos citar as iniciativas como o desenvolvimentos de documentos tais quais a “Checklist de Riscos Preliminar”, “Definição de Grau de Atenção dos Sistemas de IA”, “Avaliação de Impacto Ético”, entre outros, feitos pelo SERPRO, o Serviço Federal de Processamento de Dados, considerado a maior empresa pública de prestação de serviços em tecnologia da informação do Brasil. Há também o Projeto de Lei n° 2338, de 2023, que segue em tramitação no congresso nacional com o objetivo de regulamentar as ferramentas com esta tecnologia.

Comentários